Instalacja oprogramowania SvSAN firmy StorMagic w VMware

W tym artykule chcemy przedstawić oprogramowanie typu Software Defined Storage firmy StorMagic w systemie VMware vSphere 6.0. Dzięki SvSAN możliwe jest stworzenie współdzielonej pamięci masowej o wysokiej dostępności (high availability shared storage) z lokalnych macierzy RAID w dostępnych hostach, która może zostać wykorzystana np. przez vSphere HA, vMotion lub Distributed Ressource Scheduler (DRS).

Wymagania wstępne

SvSAN może zostać wykorzystany w systemach VMware vSphere jak i Microsoft Hyper-V.[1][2] Wymagania sprzętowe to certyfikowany system vSphere- / Hyper-V ze sprzętowym kontrolerem RAID (najlepiej kontrolerem MegaRAID firmy Avago). Zalecane przez nas systemy do tego zastosowania znajdują się na stronie StorMagic Virtual Storage.

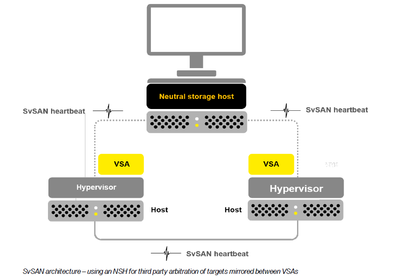

Przez SvSAN wymagane są przynajmniej dwa serwery z lokalną pamięcią masową. Dodatkowy Neutral Storage Host (NSH) może zostać udostępniony na fizycznym kliencie, lub jako instancja wirtualna. W przypadku mniejszej ilości hostów SvSAN niż 3, wirtualna instancja nie może być uruchomiona na jednym z serwerów Stormagic.

NSH jest usługą quorum między hostami, na wypadek zerwania połączenia między nimi. W przypadku utraty połączenie pomiędzy hostami może wystąpić tak zwany split-brain. W takiej sytuacji nie może zostać stwierdzony aktualny stan na innych hostach i dane są zapisywane we współdzielonej pamięci bez koordynacji z innymi hostami. Co może prowadzić do niespójności danych lub w najgorszym wypadku do ich utraty.

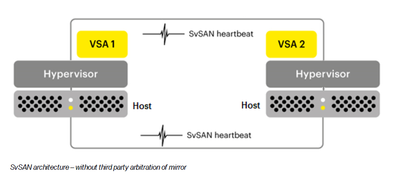

Jeżeli SvSAN jest udostępniony bez NSH, jest zalecanym przez Stormagic zastosowanie redundantnego połączenia SvSAN (Management i iSCSI).

Środowisko testowe

Ten artykuł opisuje instalację oprogramowania SvSAN w systemie VMware vSphere, w konfiguracji crossover. Poprzez bezpośrednie połączenie interfejsów 10Gb/s mogą zostać zaoszczędzone dodatkowe koszty switcha. Jeżeli jednak inne hosty mają mieć również dostęp do targetu iSCSI to połączenie musi przebiegać przez switch. Konfiguracja hosta vSphere została przeprowadzona z klienta vSphere, instalacja za pośrednictwem klienta webowego vSphere jest również możliwa.

Podstawowa instalacja oprogramowania SvSAN jest przeprowadzana bez NSH. NSH może zostać później uruchomiony jako usługa Windows lub virtual appliance, odpowiedni przykład znajduje się również w tym artykule.

W tym przykładzie zostały wykorzystane następujące komponenty:

- Płyta główna Supermicro X10DRi

- Kontroler RAID Avago MegaRAID 9361-8i

- Karta sieciowa Intel X540 10Gb/s RJ45

- ISO hiperwizora vSphere 6 Thomas-Krenn

- vCenter Server 6 Update 2 (Appliance)

- StorMagic 5.3Update 1

Konfiguracja hosta vSphere

Hosty w tym przykładzie są wyposażone w dodatkowy dysk SSD, dla instalacji hypervisora i vCenter Server. Na hostach został zainstalowany hypervisor vSphere 6 i następnie udostępnione vCenter Server 6 Appliance. Na każdym hoście zostały skonfigurowane 2 nowe wirtualne, standardowe switche z portem dla VMKernela i grupą portów dla wirtualnych maszyn. Do switcha vSwitch0 został przydzielony drugi interfejs 1GB/s na płycie głównej, vSwitch1 i vSwitch2 został skonfigurowany (każdy) z jednym interfejsem 10GB/s. Maximum Transmission Unit (MTU) dla vSwitch1, vSwitch2 i portów VMKernel musi zostać zmienione na Jumbo Frames (9000).

Uwaga: W przypadku nie korzystania z konfiguracji crossover na kartach sieciowych 10Gb/s musi na odpowiednich portach fizycznego switcha również zostać skonfigurowane Jumbo Frames.

Na koniec do każdego hosta musi zostać dodany iSCSI Software Adapter i włączony dostęp przez SSH.

-

Połączenia iSCSI i Management Network bez NSH są skonfigurowane redundantnie

-

Zmiana wartości MTU na Jumbo Frames (9000) w ustawieniach switcha

-

Zmiana MTU na porcie VMkernel (iSCSI)

-

Dodanie iSCSI Software Adapter do każdego hosta

Instalacja pluginu SvSAN

Aby móc zainstalować plugin w vCenter Server Appliance należy najpierw włączyć logowanie przez SSH i bash shell. Może zostać to przeprowadzone na stronie konfiguracyjnej vCenter Appliance. Plugin jest kopiowany za pośrednictwem WinSCP do katalogu /tmp w vCenter Appliance, następnie za pomocą chmod jest czyniony wykonywalnym i instalowany. Podczas instalacji musi zostać podany Single Sign-On (SSO) Administrator z hasłem.

Tutaj należy skontrolować czy plugin jest aktywny.

Uwaga: Jeżeli NSH ma zostać zainstalowany w vCenter Server Appliance to prosimy spojrzeć na punkt Instalacja NSH w vCenter Server Appliance.

-

Logowanie jako root na stronie konfiguracyjnej vCenter

-

Przez "Access" może zostać tymczasowo włączony dostęp przez SSH i bash shell.

-

Tutaj może zostać włączony shell basha i skonfigurowany jako stały login shell

-

Instalacja pluginu SvSAN

-

Kontrola na kliencie vSphere czy plugin jest aktywny

Udostępnienie i konfiguracja wirtualnej maszyny (VM) z SvSAN

Udostępnienie wirtualnych maszyn SvSAN (VSAs) z klienta vSphere i z klienta webowego przebiega bardzo intuicyjne. Podczas konfiguracji sieciowej należy zwrócić uwagę na typ zastosowania poszczególnych sieci, wcześniej skonfigurowane wirtualne switche są rozpoznawane automatycznie. W tym przykładzie niepartycjonowana macierz RAID jest dodawana jako RDM Device, w razie potrzeby ten punkt może zostać pominięty.

Udostępnienie SvSAN

-

Z poziomu datacenter SvSAN może zostać udostępniony w punkcie "StorMagic"

-

Tutaj należy kliknąć na "Next"

-

Wybór hosta i wprowadzenie hasła root

-

Akceptacja umowy licencyjnej

-

Konfiguracja nazwy i lokalizacji dla VSA

-

Wybór niepartycjonowanej lokalnej macierzy, żeby została ona dodana do puli

-

Konfiguracja typu dla każdej sieci, odpowiednio do zastosowania

-

Dla sieci iSCSI należy wybrać typ "iSCSI, Mirroring"

-

Dla sieci VM należy wybrać typ "Management"

-

Wprowadzenie klucza licencyjnego. Ten krok może również zostać pominięty

-

Wprowadzenia hasła administratora dla interfejsu webowego

-

Zakończenie konfiguracji przez kliknięcie na "Finish"

Konfiguracja inicjatora iSCSI i MTU

Po udostępnieniu VSA mogą zostać wprowadzone odpowiednie adresy IP dla dynamicznego rozpoznania adapterów iSCSI hostów vSphere. Nie trzeba tutaj jeszcze przeprowadzać rescanu, gdyż nie jest jeszcze skonfigurowany żaden cel iSCSI. Po zalogowaniu się do interfejsu webowego należy jeszcze skonfigurować MTU na interfejsach sieciowych 10Gb/s. Następnie skontrolować czy są zapisane credentials dla inicjatorów iSCSI. W tym przykładzie nie jest wprowadzony DNS dla VSA, dlatego podawany jest adres IP.

-

Wprowadzenie w kliencie vSpherew, w ustawieniach adaptera, adresu IP interfejsu iSCSI skonfigurowanego w VSAs. Nie przeprowadzać rescanu!

-

Login jako administrator w interfejsie webowym SvSAN

-

W panelu home są widoczne wszystkie istotne informacje o stanie

-

Kontrola czy w inicjatorze iSCSI są zapisane dane dostępowe ESXi

-

Po wyborze inicjatora mogą zostać pod "Edit Initiator" edytowane jego ustawienia

-

Jeżeli nie jest wprowadzony DNS to należy podać adres IP hosta i następnie zaakceptować przez "Apply"

-

W "Network" może zostać skontrolowane MTU interfejsów sieciowych

-

Wybór jednego interfejsu 10Gb/s i edycja jego ustawień

-

Zmiana wartości MTU na 9000 i zatwierdzenie przez "Apply"

Speedtest sieci

Za pomocą funkcji Speedtest może zostać sprawdzone połączenie między hostami i czy nie występują problemy z przepustowością w sieci. Na pierwszym hoście, na interfejsie sieciowym należy uruchomić wspomnianą funkcję dla serwera, a na drugim hoście dla klienta z podaniem wielkości pliku.

-

Aby skontrolować połączenie należy w Network przeprowadzić Speedtest

-

Wybór interfejsu na pierwszym hoście i uruchomienie usługi jako serwer

-

Również na drugim hoście należy wybrać interfejs, docelowy adres IP, wielkość i rozpocząć procedurę jako klient

Tworzenie datastore'u

Po zakończeniu instalacji VSA i skonfigurowaniu ustawień IP adapterów iSCSI hostów vSphere może zostać utworzony shared datastore. Może zostać to przeprowadzone prosto z klienta vSphere lub interfejsu webowego VSA. W tym przykładzie przedstawiamy jak może to zostać przeprowadzone w interfejsie webowym.

-

Datastore może zostać skonfigurowany w interfejsie webowym pod "Targets -> Create"

-

Wybór wielkości, dodanie inicjatorów iSCSI, wybór opcji "Mirroring" i zatwierdzenie konfiguracji przez "Create"

-

Rescan adapterów iSCSI na hostach vSphere

-

Otwarcie opcji "Manage Paths…“ dla celu

-

W tym przykładzie została wybrana opcja "Round Robin" , w ten sposób wszystkie ścieżki są aktywne

-

Wybór w "Configuration -> Storage -> Add Storage"

-

Pozostawienie jako Storgage Type opcji "Disk/LUN" i kliknięcie na "Next"

-

Tutaj jest wyświetlany SvSAN Datastore, następnie trzeba kliknąć na "Next"

-

Przegląd partycji, aby przejść dalej również należy kliknąć na "Next"

-

Wybór nazwy dla datastore'u

-

Konfiguracja wielkości

-

Zakończenie konfiguracji przez "Finish"

-

W "Datacenter -> StorMagic -> Manage shared datastores" może zostać skontrolowany status datastore'u

-

Przegląd wszystkich ścieżek do datastore'u

Instalacja NSH

NSH[3] może zostać później dodany. Dostępne są trzy opcje udostępnienia NSH; virtual Appliance, usługa w systemie Windows i 32 bitowy pakiet dla Debiana. W tym przykładzie pokazujemy opcje udostępnienia w tej samej podsieci za pomocą virtual Appliance i usługi w systemie Windows.

Instalacja usługi NSH w systemie Windows

Usługa NSH może zostać zainstalowana w powszechnie znanych wersjach systemu Windows (Windows 7 / 8, Server 2008(R2) / Server 2012(R2)). Instalacja odbywa się w kilku krokach, a usługa NSH działa w tle. W tym przykładzie usługa jest instalowana na kliencie z Windows 10, w tej samej podsieci. Jeżeli NSH znajduje sie tej samej podsieci to jest on automatycznie rozpoznawany w interfejsie webowym SvSAN.

-

Uruchomienie pliku setup.exe

-

Kliknięcie na "Next"

-

Akceptacja umowy licencyjnej i kliknięcia na "Next"

-

Wybór opcji "Custom"

-

Usunięcie opcji dla Hyper-V i kliknięcie na "Next"

-

Rozpoczęcie instalacji przez "Install"

-

W Task Manager może zostać skontrolowane czy usługa StorMagic jest uruchomiona

-

NSH jest automatycznie rozpoznawany w interfejsie webowym

-

Zmiana opcji "Isolation Policy" na "Majority", wybór NSH i zatwierdzenie przez "Edit"

Instalacja NSH Appliance

NSH Appliance może zostać udostępnione na hoście stand-alone vSphere, host musi być zarządzany przez vCenter Server. W tym przykładzie został dodany dodatkowy host, z którego jest udostępniony NSH Appliance. Nie jest konieczne, aby wchodził on w skład klastra, może on zostać dodany w vCenter jako osobny host.

-

Dodanie szablonu (template) OVF

-

Wybór szablonu OVF StorMagic

-

W szczegółach szablonu "Next"

-

Akceptacja umowy licencyjnej przez "Accept" i następnie kliknięcie na "Next"

-

Wprowadzenie nazwy dla NSH Appliance

-

Wybór lokalizacji dla Appliance

-

Wybór formatu dla dysku

-

Wprowadzenie adresu IP, lub wybór opcji DHCP

-

Zatwierdzenie konfiguracji przez "Finish"

-

Jeżeli NSH Appliance znajduje się w tej samej podsieci to jest również automatycznie rozpoznawane

-

Zmiana opcji "Isolation Policy" na "Majority", wybór NSH i zatwierdzenie przez "Edit"

Instalacja NSH w vCenter Server Appliance

NSH może zostać zainstalowane bezpośrednio w vCenter Server Appliance. Jeżeli vCenter Server Appliance uruchomione jest w klastrze SvSAN to zalecane są przynajmniej 3 hosty.

-

Wprowadzenie podczas instalacji SSO Administrator i hasła SSO

-

Jeżeli usługa NSH znajduje się w tej samej podsieci to jest również automatycznie rozpoznawane w vCenter

-

Zmiana opcji "Isolation Policy" na "Majority", wybór NSH i zatwierdzenie przez "Edit"

Odnośniki

- ↑ VMware Virtual SAN (www.stormagic.com)

- ↑ Hyper-V Virtual SAN (www.stormagic.com)

- ↑ SvSAN NSH FAQ (www.stormagic.com)

Dodatkowe informacje

- SvSAN: Simple, most cost-effective virtual SAN (www.stormagic.com)

Autor: Sebastian Koebke