Warum Deduplizierung keinen Sinn macht

3

Bei der Speicherung von Daten kommt es allzu häufig vor, dass gleiche Blöcke mehrfach abgespeichert werden. Ein gängiges Beispiel ist hierfür eine Powerpoint Präsentation, die an einen Kollegen weitergegeben wird. Dieser ändert lediglich den Namen auf der Titel-Folie, ansonsten bleibt der Inhalt gleich. Der Kollege speichert die Datei in seinem eigenen Benutzerverzeichnis ab. Somit liegen auf dem Speicher-System zwei Dateien, die aus Inhalts-Sicht zu 99% gleich sind. Auf Blöcke bezogen sind also alle Blöcke, bis auf den „Titel-Block“ 99% doppelt abgelegt. Je größer eine Firma ist, desto höher ist die Wahrscheinlichkeit von Dateien und Blöcken, die doppelt vorhanden sind. Auch bei jeder weiteren Vollsicherung im Backup-Bereich ergeben sich sehr viele Duplikate.

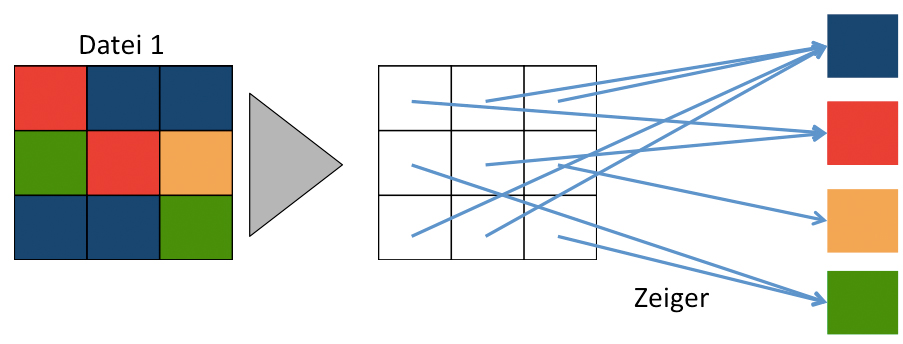

Ein System, das Deduplizierung beherrscht, untersucht nun die Daten auf Duplikate und speichert diese nur einmal ab. Das Duplikat wird nicht gelöscht, sondern beinhaltet einen Zeiger auf das Unikat. Somit ist gewährleistet, dass es aus Anwender- bzw. Applikationssicht zu keiner Veränderung gekommen ist. Das Verfahren kann entweder auf Datei- oder Blockebene angewendet werden und im laufenden Betrieb (Inline) oder im Nachgang (Post-Processing) durchgeführt werden.

Deduplizierung wurde zuerst im Backup populärDeduplizierung wurde zuerst im Backup populär, da die Infrastruktur oft nicht mehr mit der explodierenden Datenmenge zurechtkam, die es zu sichern galt. Durch Deduplizierung können die Vollsicherungen „eingedampft“ werden, ohne dass man auf inkrementelle Sicherung bei der Wiederherstellung angewiesen ist. Viele Storage-Hersteller haben sich Deduplizierung auf die Fahne geschrieben und argumentieren damit, dass sich damit sehr viel Speicherplatz einsparen lässt. Ich würde es lieber so formulieren: … sich sehr viel Platz einsparen lassen könnte. Nur weil man viele Office-User oder virtuelle Maschinen (mit dem gleichen Betriebssystem) hat, heißt dies noch lange nicht, dass man große Dedup-Einsparungen erzielt. Die namhaften Hersteller bieten zur Analyse der Daten Tools bzw. Beratungsleistungen an.

Was jedoch oft nicht beachtet wird:

- Deduplizierung ist NIE kostenlos (Performance-technisch): Entweder beim Speichern oder im Nachgang muss eine Tabelle gepflegt werden, die die Prüfsumme der einzigartigen Blöcke enthält

- Deduplizierung resultiert in einer extrem starken Bindung an einen Hersteller – Wie will man von Hersteller A zu B wechseln, wenn das logische Speichervolumen dreimal höher ist als das physikalische?

- Wenn Speicherplatz (€/GB) günstig ist dann kann man getrost auf Deduplizierung verzichten

Daneben löst Deduplizierung nur ein hausgemachtes Problem. Konzipiert man eine Speicher-Strategie, die versucht möglichst Duplikate zu vermeiden, dann kann man mit den heutigen Speichermedien (4TB HDDs) die meisten Anforderungen abdecken. Setzt man bspw. bei den Dokumenten ein entsprechendes Content Management System mit Versionierung ein, so lässt sich allein dadurch eine Vielzahl von doppelten Dokumenten vermeiden.

Deduplizierung ist nur in Ausnahmefällen sinnvollDeduplizierung kann in Ausnahmefällen bei bestimmten Szenarien sinnvoll sein, man sollte sich jedoch sehr genau mit der Analyse vorhandener Daten als auch der Methode des jeweiligen Anbieters auseinander setzen. Ergeben sich daraus signifikante Einsparungsmöglichkeiten (1 zu 10: Eine physikalisch gespeicherte Datei steht für 10 Referenzen) ist die Technologie in Erwägung zu ziehen. Trotzdem gilt es abzuwägen, ob die Vorteile der Einsparung des Speicherplatzes die Nachteile des stärkeren Lock-In als auch der höheren Performance-Kosten aufwiegen.

[…] Und genau darin liegt auch die Schwachstelle dieser Technik. Solche Szenarien sind tatsächlich denkbar und sehen in der Theorie gut aus. Dennoch sollte man diese Funktion in der Praxis mit Vorsicht betrachten und in Zeiten des günstigen Festplattenspeichers auch an bewährte – wenn auch altmodische – alternativen Denken. Das meint auch Florian Kettenbach in seinem Beitrag. […]

Ich verstehe den Sinn des Artikels nicht.

Die Deduplizierung wird im Windows 2016 doch schon „kostenlos“ mitgeliefert und funktioniert einwandfrei.

Sie reduzierte in unserem System den sinnfrei belegten Speicherplatz um mehrere hundert Gigabyte.

Wer das Prinzip der Deduplizierung verstanden hat, weiß das es geht.

Hallo,

wie Sie am Datum des Artikels erkennen können wurde dieser bereits 2013 verfasst und Windows Server 2016 wurde erst wesentlich später veröffentlicht. Gerade im IT-Bereich verläuft der technische Fortschritt rasant und Technologien werden stetig weiter verbessert und immer effizienter. Wir freuen uns, dass Sie mit der Deduplizierung in Windows 2016 zufrieden sind. Übrigens gibt es mit Windows Server 2019 bereits eine neue Version des Server-Betriebssystems.

Wir sehen es aber nicht als sinnvoll an, alte Artikel aus unserem Unternehmensblog zu löschen oder umfassend zu überarbeiten, zumal der Autor des Artikels mittlerweile nicht mehr bei Thomas-Krenn arbeitet.

Viele Grüße

Ihr Team der Thomas-Krenn.AG